【项目实训#01】Windows PyCharm (venv虚拟环境) Python PyTorch CUDA cuDNN 安装及环境配置(详细)学习分享

作者之所以使用PyCharm作为IDE、使用.venv作为虚拟环境配置,更多地是因为其对于用户的友好性,很大程度上避免了新手小白对于终端的使用及各种报错的处理。作者在过去的探索过程中也踩过很多很多坑(参考的教程可能都已经数不清了),最终按照自己的理解选择了最适合作者自己的环境配置方式。至此,踏入Python与人工智能、深度学习的第一步已经完成,无论是计算机视觉还是自然语言处理,无论是后续项目实训中

一、Python环境配置

1. Python下载

打开Python官网Welcome to Python.org,点击Downloads—Windows

(即网址Python Releases for Windows | Python.org)

在左侧“Stable Releases(稳定版)”中选择合适的版本,建议选择Windows installer (64-bit)(程序安装包),方便管理

注:如果使用的是开源项目或者是配置好的项目,建议选择项目建议的Python版本;考虑是否兼容

例如这里作者选择Python 3.10.11,点击下载python-3.10.11-amd64.exe

2. Python安装

双击.exe安装文件运行,勾选下方“Add python.exe to PATH”(添加环境变量)

点击Customize installation(个性化安装)

Optional Features(可选特征)建议默认全部勾选,点击“Next”

(建议:pip一定要勾选;td/tk and IDLE如果可能需要使用相关包的话也建议勾选,否则可能面临重装python的风险)

Advanced Options(高级选项)建议按默认勾选

“Add Python to environment variables”必须勾选

“Customize install location”作者建议自定义Python的安装路径,便于管理

点击Install即可开始安装,安装完成后关闭;之前下载的.exe安装文件可以删除

3. Python环境检查

3.1 Python版本查看

在Windows图标上右击,点击“终端(管理员)”打开Windows Powershell终端

输入命令查询Python版本:

python --version # 查询python版本若正常打印了当前安装的Python版本号,则说明Python环境已经配置完成,可以跳过3.2部分

Python 3.10.11 # 输出结果否则说明环境配置未完成,进行Python环境变量的配置

3.2 Python环境变量配置

打开Windows设置,在搜索栏搜索“环境变量”,点击“编辑系统环境变量”

点击右下角“环境变量”

找到下方“系统变量”中的“Path”变量,点击“编辑”

点击“新建”,新增两条内容分别为刚刚2.中安装时选择的目录路径和该路径下的Scripts目录

点击3次确定(注意:一定要都点确定才能更改成功),完成更改

再次按照3.1进行版本查看,如正常打印版本则配置完成

二、PyCharm集成开发环境配置

1. PyCharm下载与安装

前往JetBrains PyCharm官网下载 PyCharm:JetBrains 出品的用于数据科学和 Web 开发的 Python IDE

下载PyCharm免费版本Community Edition(网页往下翻,在下面)并安装(如不熟悉可查阅其他教程,建议在安装时语言选择“中文”)

(或者直接点击感谢您下载PyCharm!下载PyCharm Community版本)

2. 新建项目

点击左上角![]() ,文件—新建项目

,文件—新建项目

如果使用conda选择“基础conda”;新手如果不想配conda环境,建议选择解释器类型为“项目venv”

修改项目的位置,选择刚刚安装的Python版本(配置环境变量后可以在系统中自动检测到)

3. PyCharm软件包管理(.venv虚拟环境)

点击文件—设置,展开“项目:XXX”一栏,点击Python解释器,即打开Python解释器和软件包管理页面,大部分的软件包都可以在这里下载和安装

点击“+”加号,就可以搜索和添加软件包,还可以指定版本(避免了在命令行执行pip install等指令);点击“-”减号可以删除选择的软件包

然而,在一些特殊情形下仍然需要在终端执行pip命令,此时需要点击PyCharm左下栏中的终端图标,即可在当前项目目录下打开终端

特殊情形例如:

(1)当使用别人的项目时,项目中一般会有requirements.txt,可以在终端执行

pip install -r requirements.txt # 安装项目所需软件包来安装所需要的软件包

(2)当安装非CPU版本(即CUDA版本)的PyTorch时,无法从PyCharm软件包管理页面安装(该页面默认安装CPU版本),必须在终端执行,例如:

pip install torch torchvision torchaudio --index-url https://download.pytorch.org/whl/cu124三、CUDA、cuDNN与PyTorch环境配置

注:这里所叙的均为CUDA(GPU)版本,如需安装CPU版本的PyTorch,跳过这一部分,直接安装torch软件包即可

1. CUDA版本选择

CUDA的版本选择主要有如下两个因素:

1.1 本机所支持的最高CUDA版本

打开终端并执行如下命令:

invidia-smi.exe # 查看Nvidia显卡状态可以看到表格第一行右侧的“CUDA Version:XX.X”,这就是该显卡所支持的最高CUDA版本,所安装的CUDA版本不能高于该版本

1.2 PyTorch所支持的CUDA版本

访问PyTorch官网PyTorch,点击“Previous versions of PyTorch”,可以查看PyTorch的所有版本

(即Previous PyTorch Versions | PyTorch)

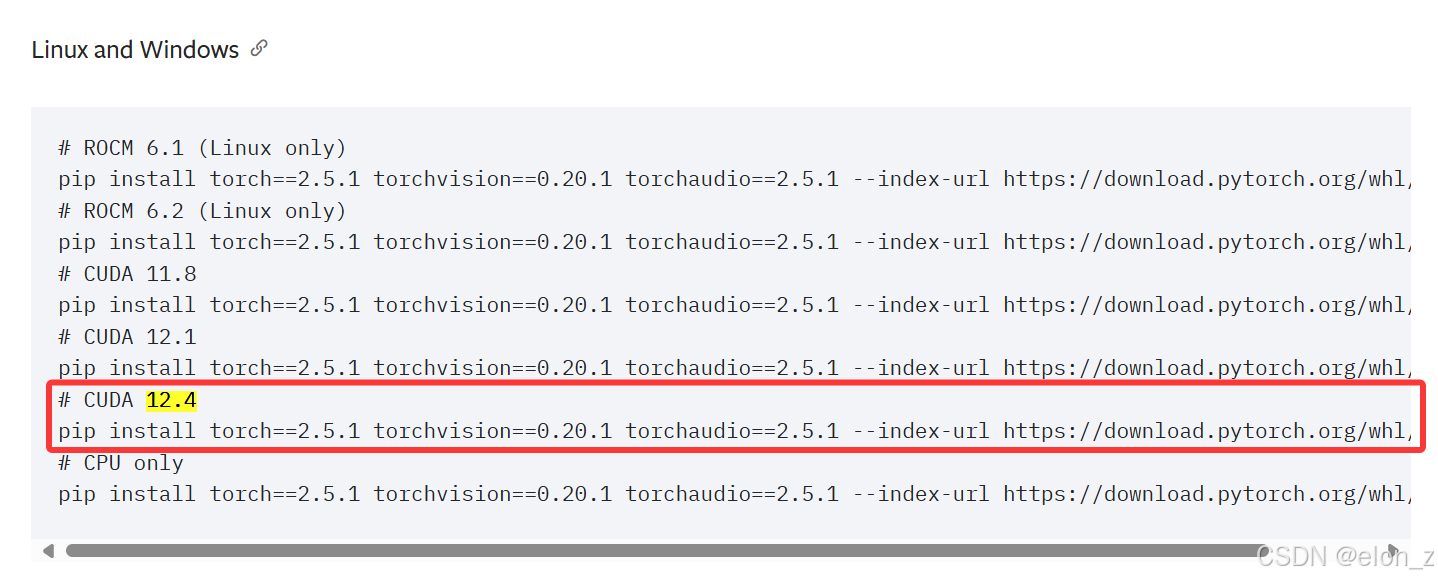

可以按F3键搜索对应的CUDA版本;一般选择PyTorch支持且≤本机支持版本的最高版本即可

复制该pip命令备用(也可以直接在PyTorch主页选择(如果有合适的话)并复制)

2. CUDA配置

2.1 CUDA下载

访问CUDA官网CUDA Toolkit Archive | NVIDIA Developer找到1.中选定的CUDA版本并点击

选择对应的系统环境,点击Download开始下载

2.2 CUDA安装

选择安装路径,作者设置为C:\Program Files\NVIDIA GPU Computing Toolkit\CUDA\v12.4

安装选项选择“自定义”

自定义安装选项勾选如下图即可(没有安装Visual Studio不能勾选“Visual Studio Integration”)

点击下一步等待安装完成即可

2.3 CUDA环境检查

打开终端,输入如下命令:

nvcc -V # 查询CUDA版本若打印如下CUDA版本信息,则说明CUDA环境配置完成

3. cuDNN配置

3.1 cuDNN下载

访问cuDNN官网cuDNN Archive | NVIDIA Developer

注意每行后面的“for CUDA XX.x”,选择符合刚刚安装的CUDA版本的点击展开

选择第一个链接“Local Installer for Windows (Zip)”(这里下载可能需要登录,如没有账号可以注册一下)

解压后将这3个文件夹复制到CUDA的安装路径下,这里为C:\Program Files\NVIDIA GPU Computing Toolkit\CUDA\v12.4

3.2 cuDNN环境变量配置

编辑系统环境变量,在PATH变量中添加如下4个路径(前面的路径为CUDA路径):

C:Program Files\NVIDIA GPU Computing Toolkit\CUDA\v12.4\bin

C:Program Files\NVIDIA GPU Computing Toolkit\CUDA\v12.4\libnvvp

C:Program Files\NVIDIA GPU Computing Toolkit\CUDA\v12.4\lib

C:Program Files\NVIDIA GPU Computing Toolkit\CUDA\v12.4\include3.3 cuDNN环境检查

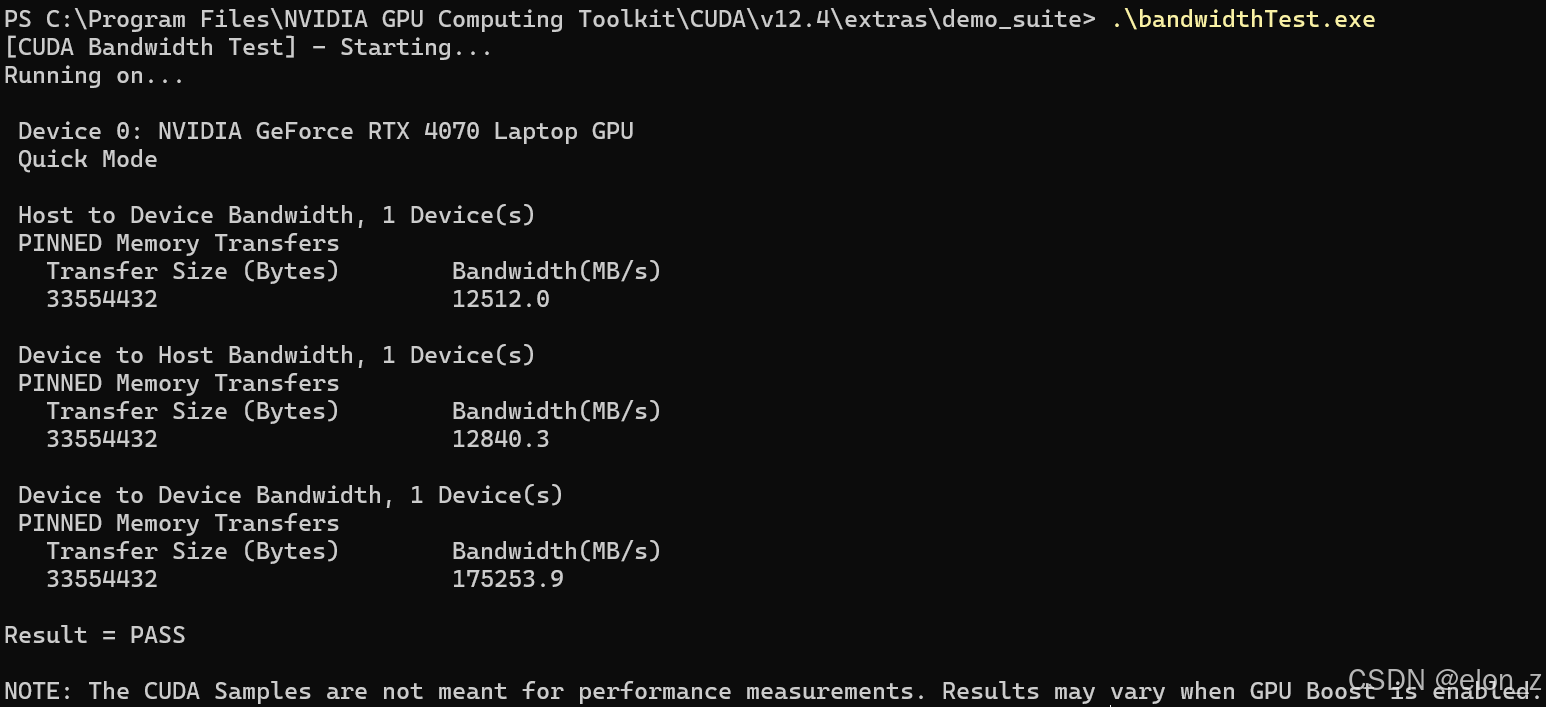

在CUDA安装路径\extras\demo_suite(如C:\Program Files\NVIDIA GPU Computing Toolkit\CUDA\v12.4\extras\demo_suite)目录下,右击“在终端打开”

执行如下命令:

.\bandwidthTest.exe输出结果正常即可

4. PyTorch配置

4.1 PyTorch软件包安装(pip+venv)

在PyCharm打开项目,并打开终端,注意确保在项目虚拟环境“(.venv)”中

访问PyTorch官网PyTorch,选择Windows、Pip,以及合适的CUDA版本,这里以CUDA12.4为例

(如无可点击“Previous versions of PyTorch”,可以查看PyTorch的所有版本,即Previous PyTorch Versions | PyTorch )

pip3 install torch torchvision torchaudio --index-url https://download.pytorch.org/whl/cu124在终端执行该命令,等待安装完成

4.2 PyTorch(CUDA版本)测试程序

import torch

# 1. 检查 PyTorch 版本

print("PyTorch 版本:", torch.__version__)

# 2. 检查 GPU 是否可用

if torch.cuda.is_available():

print("GPU 可用,设备名称:", torch.cuda.get_device_name(0))

else:

print("GPU 不可用,将使用 CPU")

# 3. 创建一个简单的张量并进行计算

x = torch.tensor([1.0, 2.0, 3.0])

y = torch.tensor([4.0, 5.0, 6.0])

z = x + y

print("张量计算结果:", z)

# 4. 如果 GPU 可用,将张量移动到 GPU 并计算

if torch.cuda.is_available():

x = x.to("cuda")

y = y.to("cuda")

z = x + y

print("GPU 上的张量计算结果:", z)

else:

print("GPU 不可用,无法在 GPU 上进行计算")AI生成的一个简单的测试程序,示例输出结果:

PyTorch 版本: 2.6.0+cu124

GPU 可用,设备名称: NVIDIA GeForce RTX 4070 Laptop GPU

张量计算结果: tensor([5., 7., 9.])

GPU 上的张量计算结果: tensor([5., 7., 9.], device='cuda:0')四、总结

作者之所以使用PyCharm作为IDE、使用.venv作为虚拟环境配置,更多地是因为其对于用户的友好性,很大程度上避免了新手小白对于终端的使用及各种报错的处理。作者在过去的探索过程中也踩过很多很多坑(参考的教程可能都已经数不清了),最终按照自己的理解选择了最适合作者自己的环境配置方式。

至此,踏入Python与人工智能、深度学习的第一步已经完成,无论是计算机视觉还是自然语言处理,无论是后续项目实训中可能用到的知识图谱还是大模型微调,这都将是重要的一小步。

欢迎来到由智源人工智能研究院发起的Triton中文社区,这里是一个汇聚了AI开发者、数据科学家、机器学习爱好者以及业界专家的活力平台。我们致力于成为业内领先的Triton技术交流与应用分享的殿堂,为推动人工智能技术的普及与深化应用贡献力量。

更多推荐

已为社区贡献1条内容

已为社区贡献1条内容

所有评论(0)