PyTorch Conference 2024大会概况及FlagGems/FlagAttention算子库亮相

因此,本届 PyTorch 大会所宣讲的绝大多数内容都或多或少涉及大模型的训练、微调、对齐、推理、量化、部署、评测、数据、结构细节、底层编译优化等关键话题,以及整个 PyTorch 生态社群在过去一年中与之相关的努力。本届的例行报告本身包含五个部分,其中最后三个分别对应 PyTorch 官方今年新推出的三个原生大模型库:用于大规模预训练的 TorchTitan、用于大模型微调的 TorchTune

大会概况

2024 年度 PyTorch 大会于 9 月 18 日至 19 日,在风景如画的旧金山 Fort Mason Center(福特梅森中心)盛大举行。本次会议地点曾是军事要塞,现已华丽转变为公共文化空间,其广阔的场馆完美承载了这场科技盛会。

本届 PyTorch 大会有超过 1600 从业人士注册参与,为期两天,主要内容包括主题演讲(keynotes)、分会场报告以及海报展示环节。

分会场报告部分会有三个分会场同时进行内容多样的口头报告,其中也穿插了两个“迷你峰会”中的专题报告,主题分别是 DL Compiler 以及 Fine Tuning。从去年的 PyTorch 大会发布 2.0 版本开始,DL Compiler 就成为了 PyTorch 的技术热词,并带动着编译器技术在 AI 系统领域的新发展。

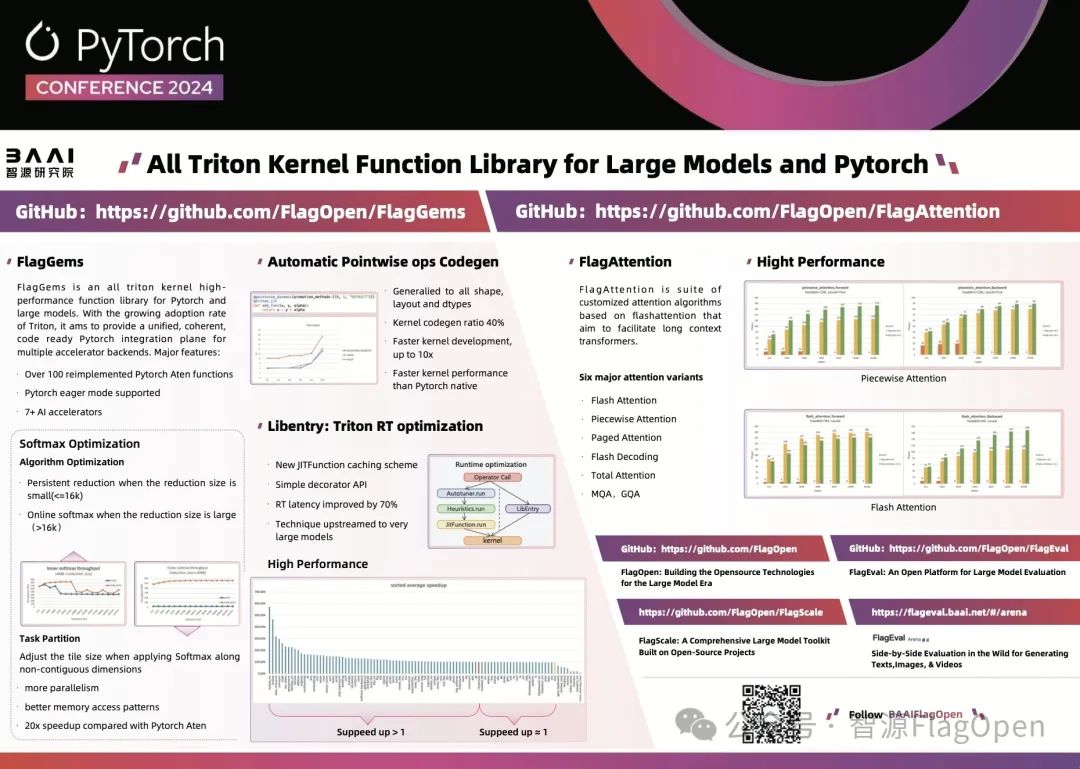

智源研究院在本届大会中向参会者介绍了基于 Triton 的 FlagGems 和 FlagAttention 两项开源项目成果。由于前一天(9 月 17 日)在湾区刚举办完Triton大会,在本次 PyTorch 大会中,Triton 作为被 PyTorch 首个支持的、用于 AI 算法加速的开源编程语言和编译器,也是备受关注。

作为本次大会唯一亮相的 Triton 相关开源项目,FlagGems 开源了基于 Triton 语言实现和优化的超过 100 个 AI 核心算子集,引起众多参会者、国外芯片厂商的关注。经过与 CUDA 原生算子的性能比较,FlagGems 的 100 多个算子中,有 90% 以上都达到或超过了CUDA 算子在英伟达 GPU 上的性能。

通过与多个芯片厂商合作,FlagGems 和 FlagAttention 两大算子库已经支持了 7 家不同厂商的芯片,也证明了 FlagGems 算子库的跨芯片架构的支持和优化能力。对大模型开发者而言,使用 PyTorch+FlagGems/FlagAttention+Triton 的搭配,可以实现算法的跨平台训练或推理。

FlagGems 开源项目地址:https://github.com/FlagOpen/FlagGems

FlagAttention 开源项目地址:https://github.com/FlagOpen/FlagAttention

本次大会的多家赞助厂商的展台,也展出了各自的最新的技术产品,吸引了广大参会者前往交流问询。其中印象较深的是 AI 芯片初创企业 d-Matrix,展出了最新的 Cosair,其单芯片能力可以到 1.2PFLOPS、128GB 显存。据说,正式发布将在 11 月份的 SuperComputing 大会,目前可以接受重要用户的试用申请。

Meta 在大会中的曝光度和参与度十分突出。作为整个 PyTorch 生态最大的推手与维护者,参会证上印有 Meta 字样的参会人员随处可见。

在过去的短短一年时间里,大模型与生成式 AI 技术更新迭代速度飞快,它们毋庸置疑是整个行业最大的焦点所在。因此,本届 PyTorch 大会所宣讲的绝大多数内容都或多或少涉及大模型的训练、微调、对齐、推理、量化、部署、评测、数据、结构细节、底层编译优化等关键话题,以及整个 PyTorch 生态社群在过去一年中与之相关的努力。很多 PyTorch 生态下影响力较高、应用广泛的知名项目都在大会中报告宣讲,如为现代大模型注意力机制多处实现细节提供高效完整实现的 FlexAttention,高效且易用的大模型推理库 vLLM 等。

主题报告

本届大会包含七个传统意义上的主题报告,分别在每天上午最开始的环节进行。此外,大会的每个钻石级赞助商(Meta 除外)都会给出“赞助主题报告”,宣讲一些各自与 PyTorch 生态的联系与贡献。

大会首日在 PyTorch 基金会新任执行董事 Matt White 做了短暂的开幕报告之后,按照惯例,第一个主题报告便是来自 PyTorch 核心开发团队对过去一年 PyTorch 开发更新的综述。

例行 PyTorch 更新总结

本届的例行报告本身包含五个部分,其中最后三个分别对应 PyTorch 官方今年新推出的三个原生大模型库:用于大规模预训练的 TorchTitan、用于大模型微调的 TorchTune、用于大模型端侧部署推理的 TorchChat。

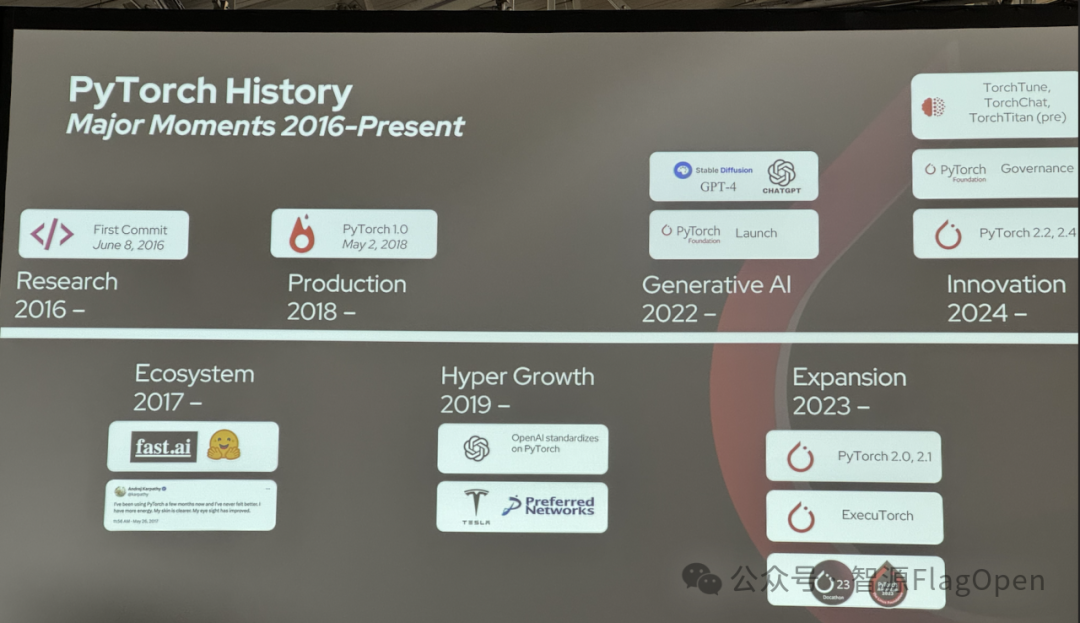

PyTorch 的过去、现在与未来

NVIDIA PyTorch 核心团队负责人 Piotr Bialecki 带领与会者回顾了 PyTorch 自 2016 年推出以来的版本演进和关键更新。尤其是过去的一年里,PyTorch 在整个机器学习领域产生的影响力也在进一步扩大,贡献者、使用者群体也依然在继续增长。

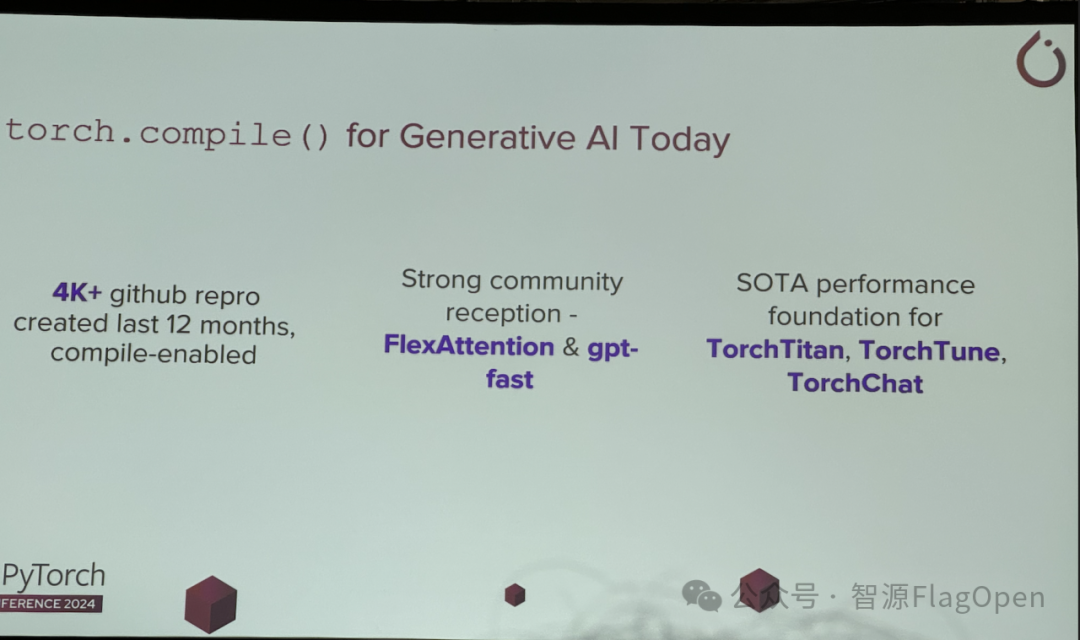

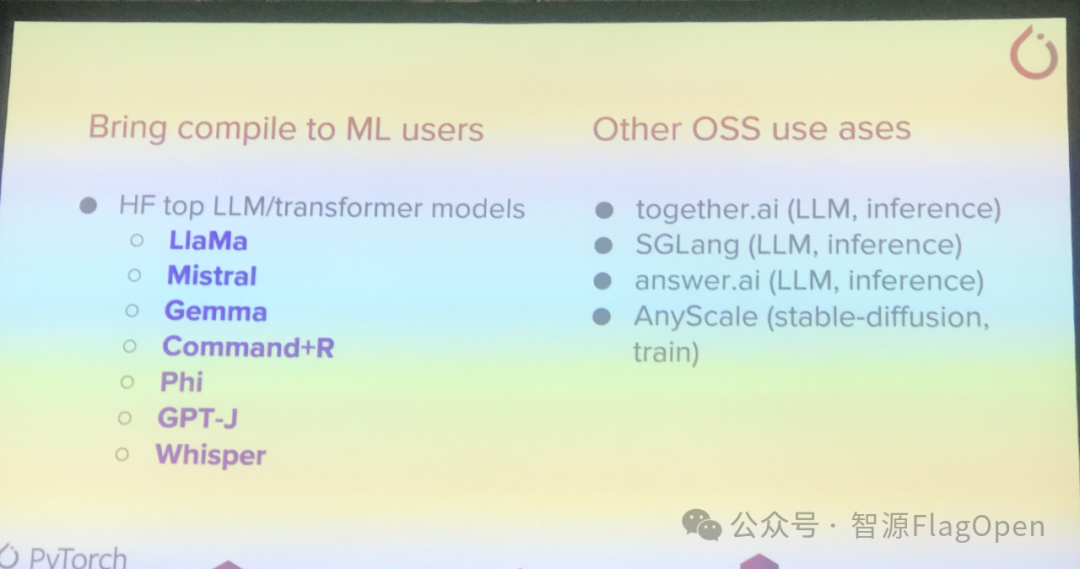

适配现代生成式 AI 的 torch.compile()

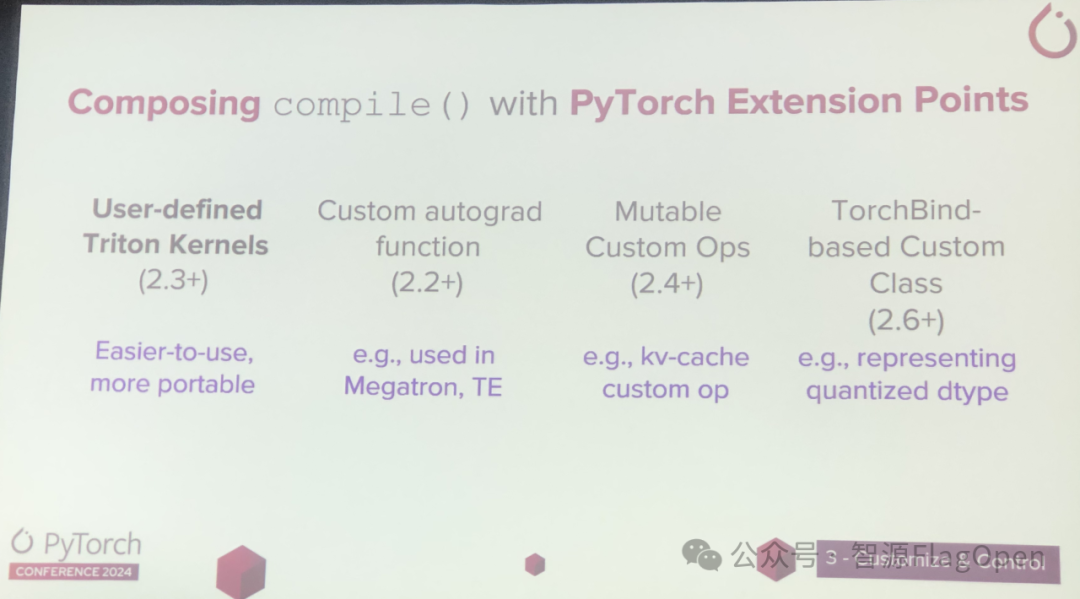

PyTorch 编译器团队主管 Peng Wu 介绍了 torch.compile() 的更新,包括对今年新增的 FlexAttention、gpt-fast、TorchTitan、TorchTune、TorchChat 等 PyTorch 官方原生库编译提供高性能 kernel,并为开发者装配大量扩展点。

过去一年 torch.compile() 的功能已经支撑了众多优秀的大模型工作、以及开源软件企业用户。

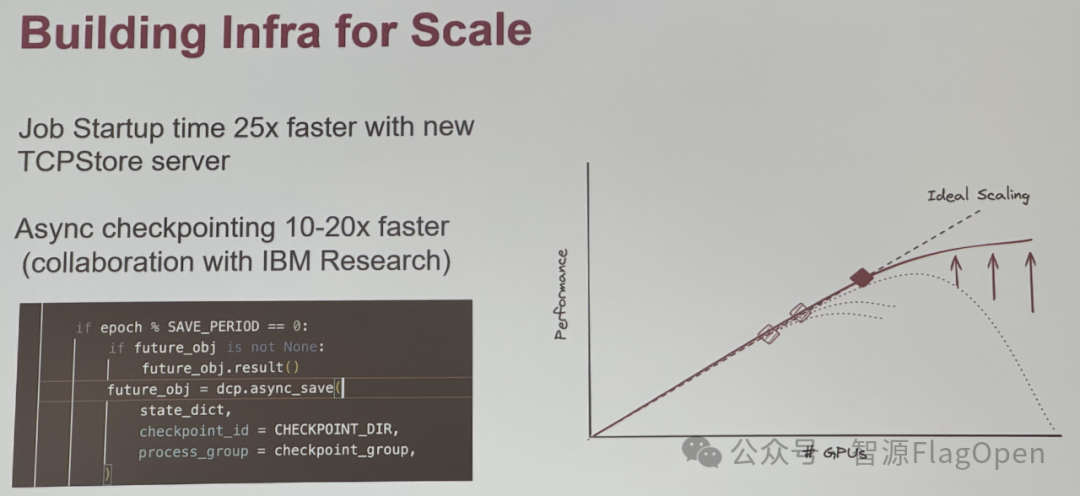

TorchTitan: 通过可组合 API 实现无缝扩张

PyTorch 分布式算法与基建核心成员 Will Constable 向大家介绍 PyTorch 官方原生大模型库 TorchTitan,其中集成了类 Llama 大语言模型预训练必不可少的数据并行、张量并行、流水线并行常见策略的原生实现,以及缓解真实训练中所出现各种问题的基建支持。

TorchTune: 仅用 PyTorch 完成现代大语言模型微调

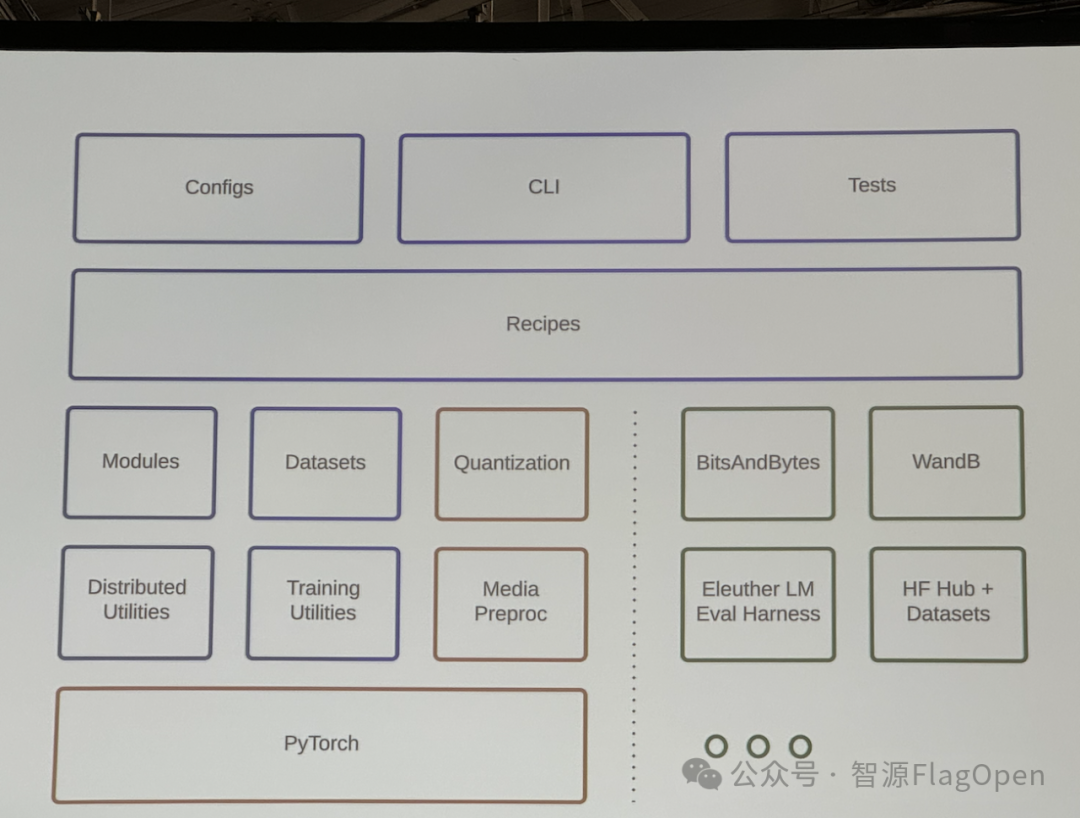

PyTorch AI 基建开发工程师 Kartikay Khandelwal 介绍 PyTorch 官方原生库 TorchTune,为不同背景、掌握不同计算资源的开发者正式提供了大语言模型微调常见方法的高效官方支持,提供了便于使用与适配的微调样例。

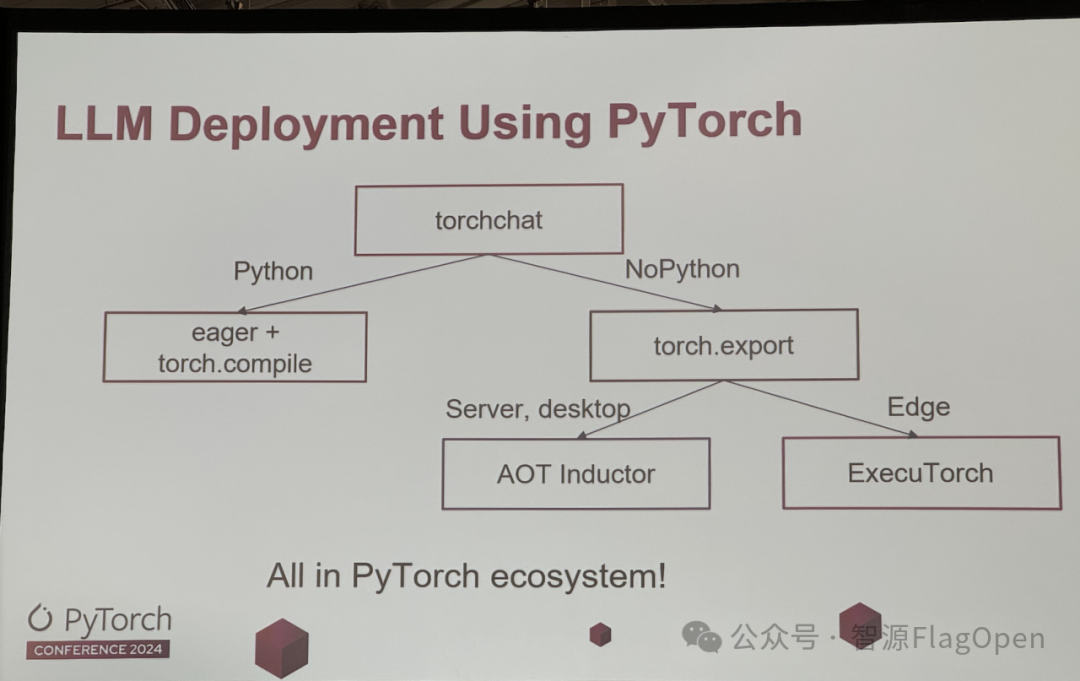

TorchChat: 部署

PyTorch 端侧团队主管 Mengtao (Martin) Yuan 介绍 PyTorch 官方原生库 TorchChat,给出了在不同条件与计算环境下如何在 PyTorch 原生生态内进行大语言模型高效部署推理的方法,尤其是基于 ExecuTorch 的 PyTorch 大模型端侧部署。

而这三套原生库在本次大会中也都分别在后续的分会场进行了更详细的宣讲与展示。

其他主题报告

大会的其他主题报告也都涉及大模型与生成式 AI 的方方面面。每个报告时长仅 15 分钟,以概览为主。

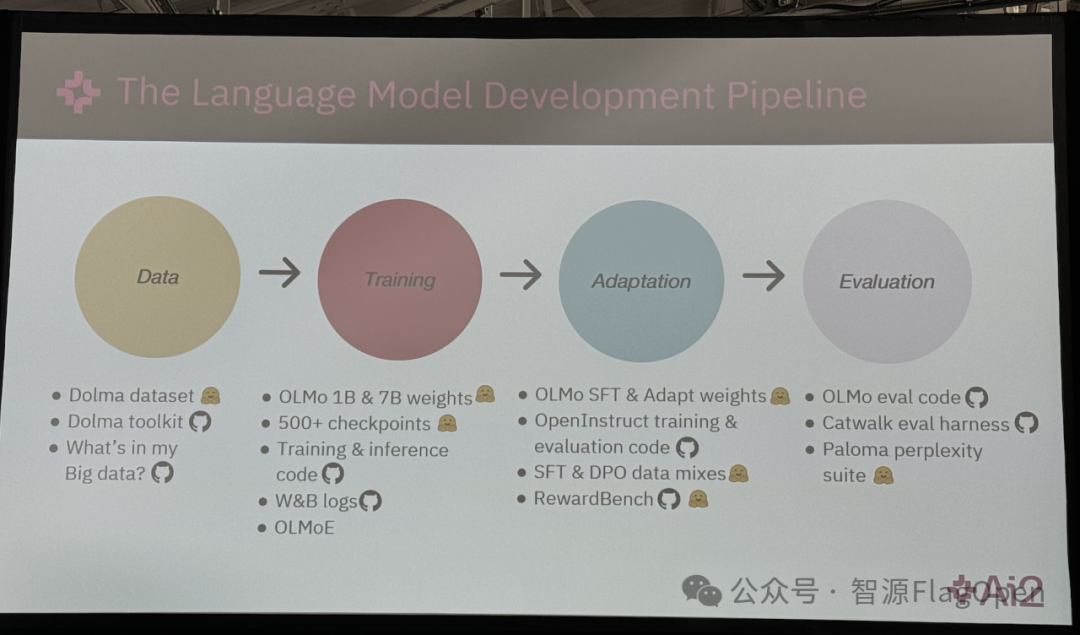

AI2 高级研究主管 Hanna Hajishirzi 宣讲了完全意义上开放的大语言模型 OLMo。包括了开源了预训练数据集 Dolma,500 多个训练过程的 checkpoints,训练及推理代码,后训练的数据集、评测代码等等。大家可以从下图看到 Ai2 的开源,还是相当彻底。

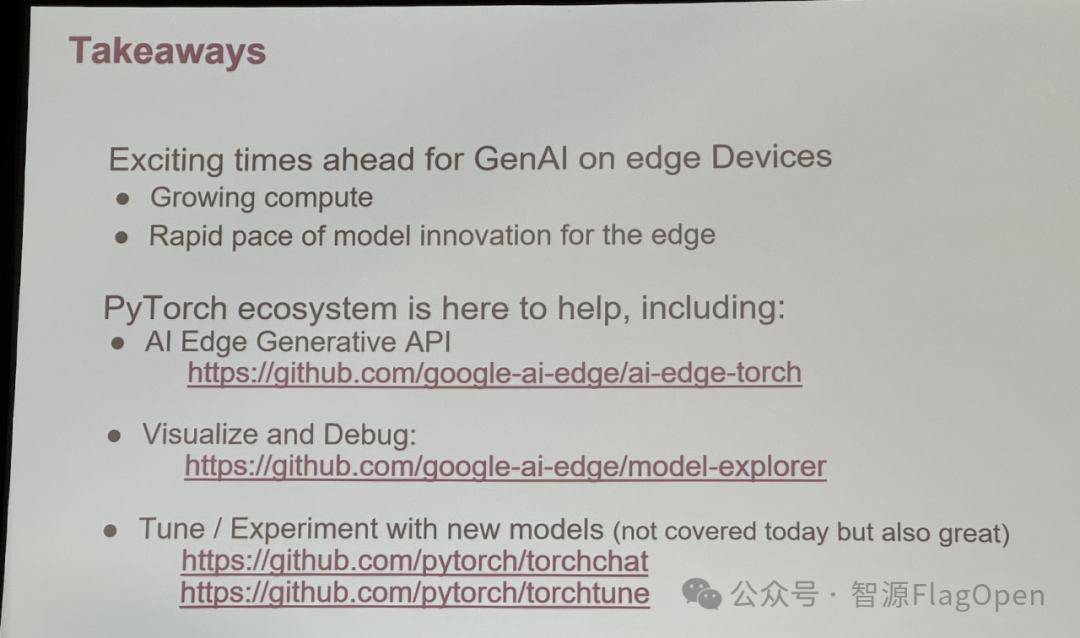

过去 12 个月,端侧大模型发展迅猛。谷歌资深工程师 Cormac Brick 介绍了基于 PyTorch、谷歌的 AI Edge Torch 和 LiteRT 在端侧部署生成式 AI 模型的常见做法与工具。

第二天主题报告

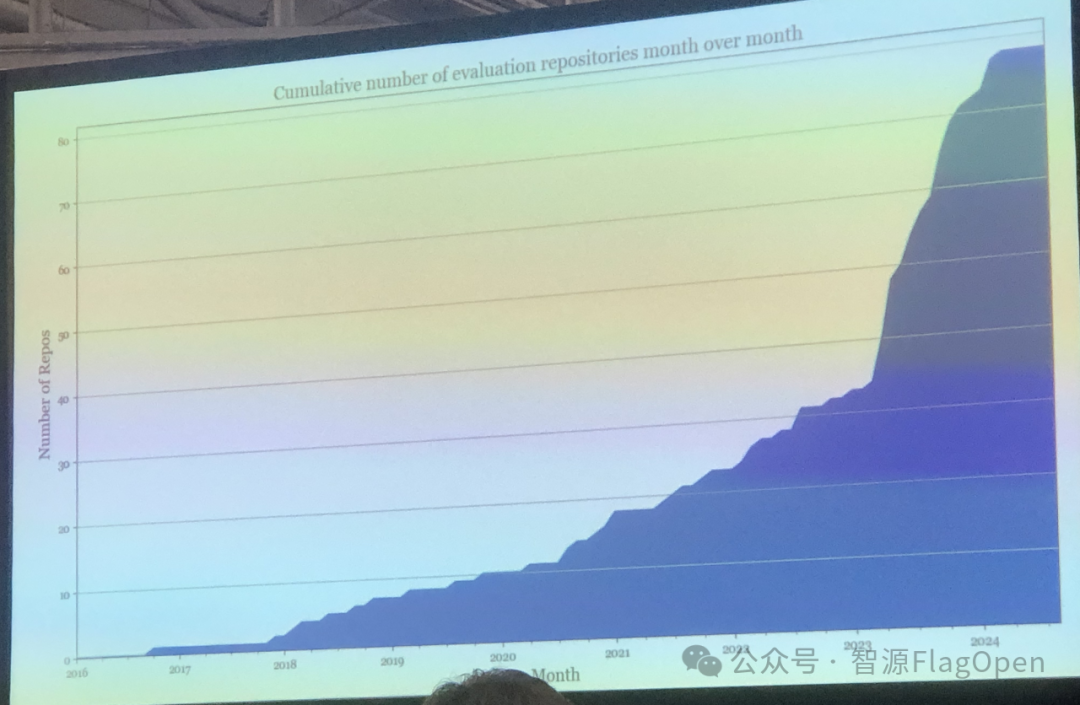

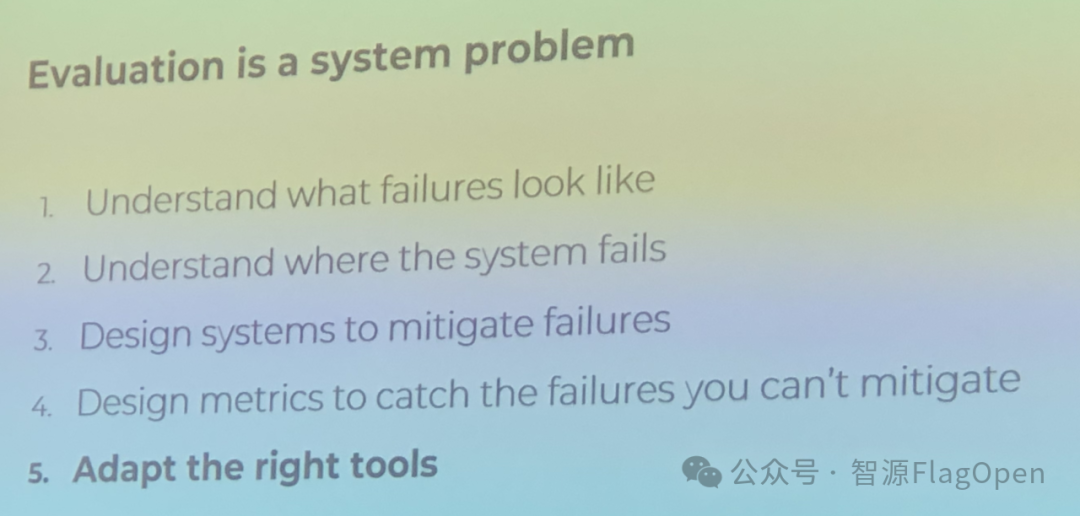

过去 1 年,有许多开源项目围绕大模型评测开展(如下图所示)。机器学习应用系统知名专家 Chip Huyen 强调了大模型时代评测的重要性、大模型幻觉问题等主要关注点。她提出了对于大模型而言,评测是降低风险、发现机会的重要工具 —— "Evaluation = mitigate risks + uncover opportunities"

并指出使用外部评测工具所需要注意的问题:评测对象往往是整个系统而不是大模型本身,需要用系统视角正确分析和理解大模型出错的问题来源。

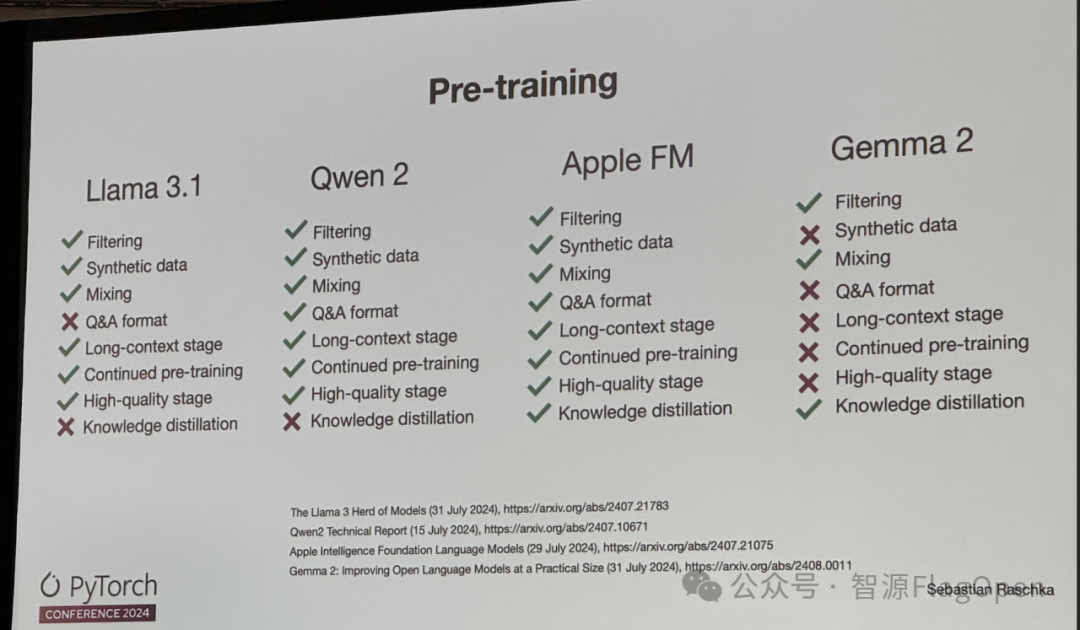

Ligntning AI 知名机器学习工程师 Sebastian Raschka 带大家回顾了 2024 年前沿大模型在数据、架构等方面出现的新变化。

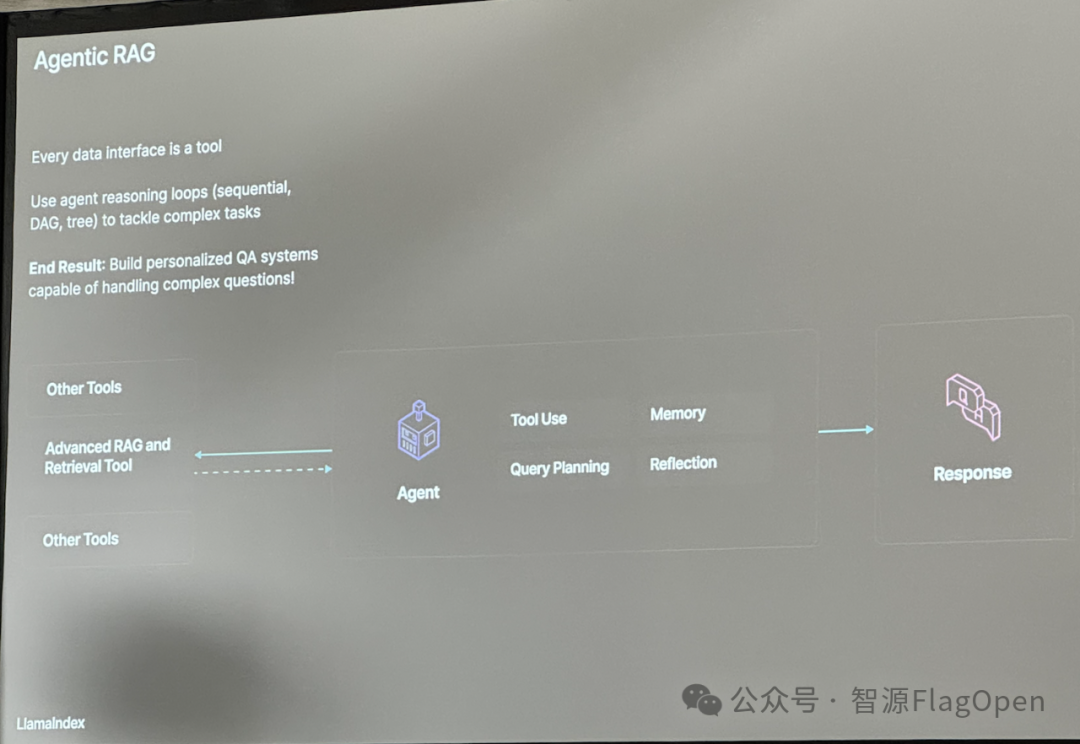

初创公司 LlamaIndex 的首席执行官 Jerry Liu 探讨了基于 RAG 的大模型智能体目前的进展、应用场景与产品化机遇。

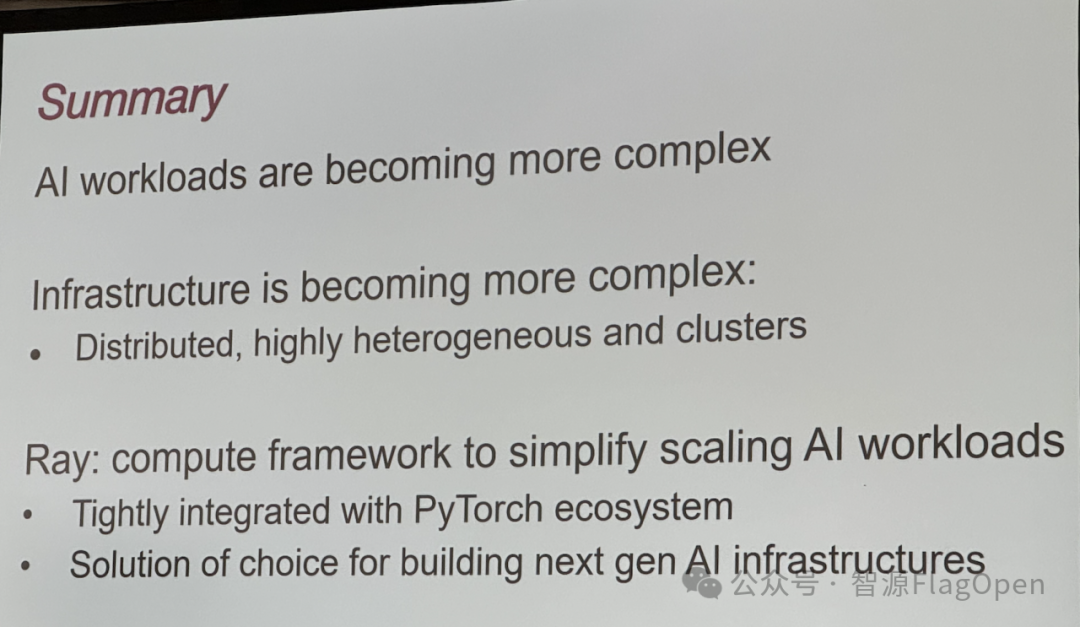

加州大学伯克利分校的 Ion Stoica 教授向大家介绍分布式异构计算框架 Ray 的基本特性,以及近期对 GPU 集群的支持。

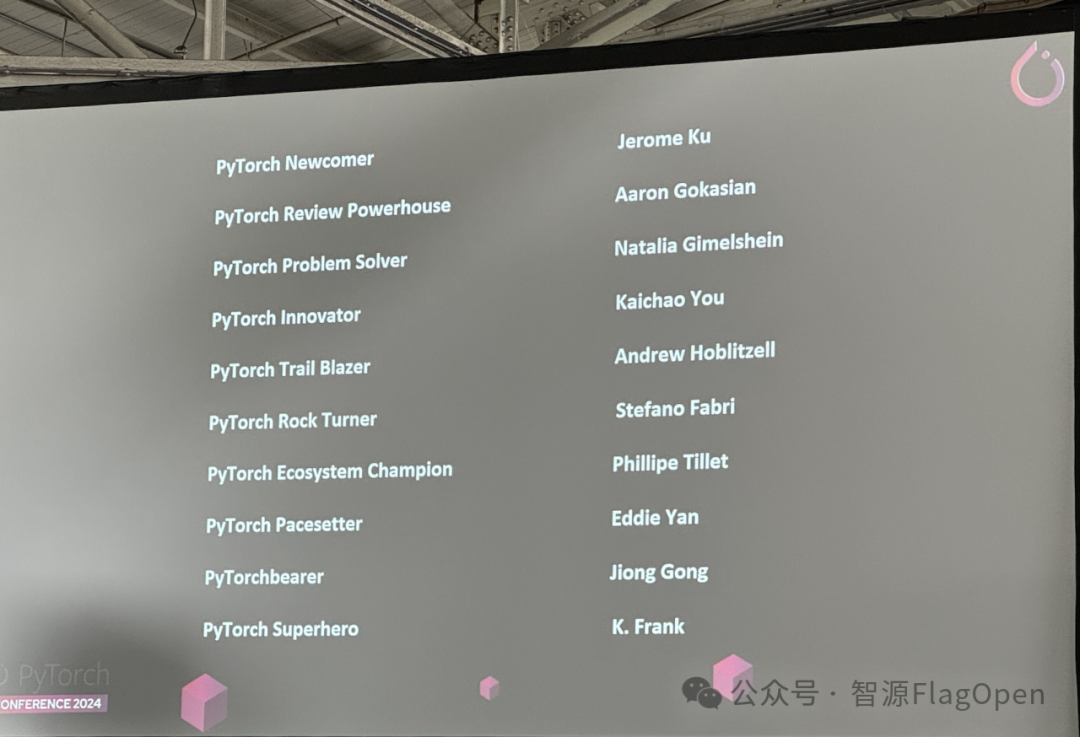

大会奖项

大会为过去一年中 PyTorch 社区的杰出贡献者颁发了奖项。其中,正在加州大学伯克利分校访问的清华大学博士生游凯超凭借开源编译分析库 depyf 获得今年的 PyTorch 创新者称号。

展望

大模型与生成式 AI 技术更新速度飞快,不管是大规模训练基础架构还是底层模型细节、编译优化,都会因为各个机构、团队的不断探索与实践而产生变化,也给整个人工智能行业带来了新的发展机遇以及运维方面的挑战。伴随着相关技术的热度,PyTorch 社区会继续不断壮大,而行业技术的进一步探索与发展也离不开 PyTorch 开发生态下整个社区齐心协力,保持不断的技术迭代、基础开发和分析工具的逐步完善。开放与协作将会继续成为开源社区应对技术复杂化的有效方式。

扫码回复“Triton”

加入Triton中文社区交流群

欢迎来到由智源人工智能研究院发起的Triton中文社区,这里是一个汇聚了AI开发者、数据科学家、机器学习爱好者以及业界专家的活力平台。我们致力于成为业内领先的Triton技术交流与应用分享的殿堂,为推动人工智能技术的普及与深化应用贡献力量。

更多推荐

已为社区贡献27条内容

已为社区贡献27条内容

所有评论(0)