Triton Inference Server PyTorch 后端使用教程

Triton Inference Server PyTorch 后端使用教程pytorch_backend项目地址:https://gitcode.com/gh_mirrors/py/pytorch_backend 1. 项目的目录结构及介绍.├── github│└── workflows│├── cmake│└── src├── tools│...

·

Triton Inference Server PyTorch 后端使用教程

pytorch_backend项目地址:https://gitcode.com/gh_mirrors/py/pytorch_backend

1. 项目的目录结构及介绍

.

├── github

│ └── workflows

│ ├── cmake

│ └── src

├── tools

│ └── clang-format

├── .gitignore

├── .pre-commit-config.yaml

├── CMakeLists.txt

├── LICENSE

├── README.md

├── pyproject.toml

github/workflows: 包含项目CI/CD工作流的配置文件。tools/clang-format: 包含代码格式化工具的配置文件。.gitignore: 指定Git版本控制系统忽略的文件和目录。.pre-commit-config.yaml: 预提交钩子的配置文件。CMakeLists.txt: CMake构建系统的配置文件。LICENSE: 项目的许可证文件。README.md: 项目的主文档,包含项目的基本信息和使用说明。pyproject.toml: 项目构建和包管理的配置文件。

2. 项目的启动文件介绍

项目中没有明确的“启动文件”,因为Triton Inference Server的PyTorch后端主要是通过配置和构建来使用的。具体的启动和运行过程通常涉及以下步骤:

- 构建项目:使用CMake进行构建。

- 配置模型:在Triton Inference Server中配置模型和后端。

- 启动服务器:运行Triton Inference Server以加载配置的模型并提供推理服务。

3. 项目的配置文件介绍

CMakeLists.txt: 用于配置和构建项目的CMake文件。.pre-commit-config.yaml: 用于配置预提交钩子,确保代码提交前通过一系列检查。pyproject.toml: 用于配置项目构建和包管理的文件。

这些配置文件共同确保了项目的正确构建和运行,以及代码的质量和一致性。

pytorch_backend项目地址:https://gitcode.com/gh_mirrors/py/pytorch_backend

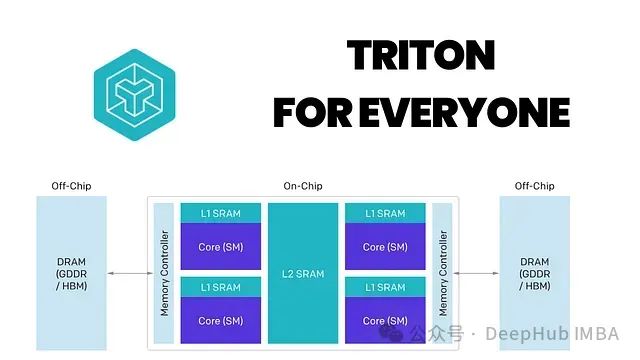

欢迎来到由智源人工智能研究院发起的Triton中文社区,这里是一个汇聚了AI开发者、数据科学家、机器学习爱好者以及业界专家的活力平台。我们致力于成为业内领先的Triton技术交流与应用分享的殿堂,为推动人工智能技术的普及与深化应用贡献力量。

更多推荐

已为社区贡献1条内容

已为社区贡献1条内容

所有评论(0)