cuda out of memory(pytorch)问题的解决

最近在训练网络,发现无法使用GPU,一直报错cuda out of memory.查阅了网上很多方法,记录一下我的解决过程。可能原因及解决方法(一)原因:大量其他进程占用了GPU解决:kill占用GPU的进程,释放GPU参考博文:链接(二)原因:batch_size过大解决:将batch_size调小一点,再次测试看能否运行。(三)原因:不知道这个怎么描述,没有用到所有的GPU?解决:在代码中添加

最近在训练网络,发现无法使用GPU,一直报错cuda out of memory.查阅了网上很多方法,记录一下我的解决过程。

可能原因及解决方法

(一)

原因:大量其他进程占用了GPU

解决:kill占用GPU的进程,释放GPU

参考博文:链接

(二)

原因:batch_size过大

解决:将batch_size调小一点,再次测试看能否运行。

(三)

原因:不知道这个怎么描述,没有用到所有的GPU?

解决:在代码中添加os.environ['CUDA_VISIBLE_DEVICES']="0, 1",这个序号是你的设备的GPU的编号,我的设备上只有0,1号GPU。

参考博文:链接

(四)

原因:程序运行过程中产生大量中间量,pytorch不清除这些中间量,从而造成了GPU爆内存。

解决:清除过程中产生的中间量

参考博文:添加链接描述

我的问题的解决

修改过程

上述的(一)(二)(三)(四)都尝试了之后,未能解决我的程序的问题。

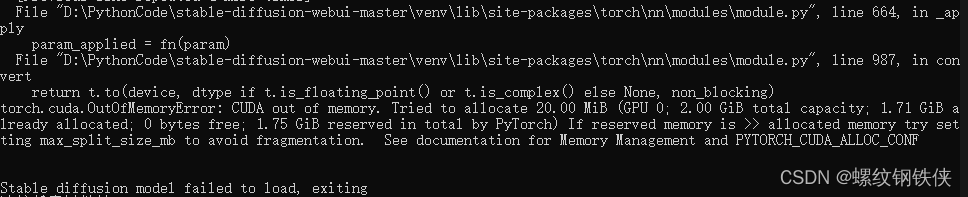

我的程序报错的地方:

将其改为:

这一步不保存中间的梯度信息。

继续报错:element 0 of tensors does not require grad and does not have a grad_fn

继续改,原因是require_grad是False,改为True:train_loss = train_loss.requires_grad_(True)

哦莫,就成了!喜大普奔!还是GPU跑得快啊!

说明

当我把batch_size改成8后就又跑不动了,我的GPU太拉胯了,最后batch_size改为4跑的。

小疑问

运行时,CPU的利用率70%+,GPU0的利用率恒为1%,GPU1的利用率不到20%,磁盘利用率大幅增加。为什么CPU的利用率仍然这么高?而GPU的利用率却不是很高?之前用CPU跑的时候,每次CPU的利用率都接近100%。难道是我电脑显卡不好?!

欢迎来到由智源人工智能研究院发起的Triton中文社区,这里是一个汇聚了AI开发者、数据科学家、机器学习爱好者以及业界专家的活力平台。我们致力于成为业内领先的Triton技术交流与应用分享的殿堂,为推动人工智能技术的普及与深化应用贡献力量。

更多推荐

已为社区贡献1条内容

已为社区贡献1条内容

所有评论(0)